Ejecutar los tests

Cómo se conecta el agente de IA, cómo se arman Test Plans y cómo se corre. Todo lo que pasa cuando haces clic en Run.

Modelo mental

Para ejecutar necesitas 3 piezas:

- Una Agent Connection — el agente de IA que vas a probar.

- Una Test Suite — los casos que quieres correr.

- Un Test Plan — la receta que combina los dos anteriores.

Una vez que tienes el Test Plan, puedes correrlo todas las veces que quieras. Cada corrida queda como un Run inmutable.

1. Configurar la Agent Connection

Ve a Configuration → AI Agents → + New Connection.

Conexión por Browser (Playwright)

Para agentes de IA embebidos en una página web. ArtificialQA corre Chromium headless en sus workers en la nube y lo opera como lo haría un usuario.

- Chat URL: la URL donde está el chat.

- La ejecución corre en nuestros workers en la nube en modo headless (sin ventana visible).

- Login Steps: si el chat requiere login, defines la secuencia de pasos (selector + acción) para llegar autenticado al chat.

- Selectors: dónde está el input del usuario, dónde aparece la respuesta del bot, indicador de "está escribiendo", etc.

- Timeouts: cuánto esperar la respuesta antes de marcar timeout.

Conexión por HTTP/API (plan Pro o Enterprise)

Para agentes de IA que exponen un endpoint propio.

- Base URL: el endpoint del agente.

- Method: GET o POST.

- Authentication: Bearer Token, API Key (en header o query) o Custom Headers.

- Request Body: el template del cuerpo del request, indicando dónde se inserta el mensaje del usuario (placeholder).

- Response Mapping: qué campo del response contiene la respuesta del bot (path tipo

data.message.content).

Test Connection

Una vez guardada la conexión, usa el botón Test Connection para validarla. Manda un mensaje de prueba y muestra qué se envió y qué se recibió. Si falla, verás el error exacto (timeout, 401, selector no encontrado, etc.).

2. Armar un Test Plan

Ve a Test Design → Test Plans → New Plan. Indica:

- Nombre: nombre identificable (ej: "Smoke v1.4 — Producción").

- Descripción (opcional): una nota breve sobre qué cubre este plan.

Una vez creado el plan, entra a su detalle y asigna una o más Test Suites. Un Test Plan puede contener múltiples suites — todas se ejecutan juntas cuando corres el plan.

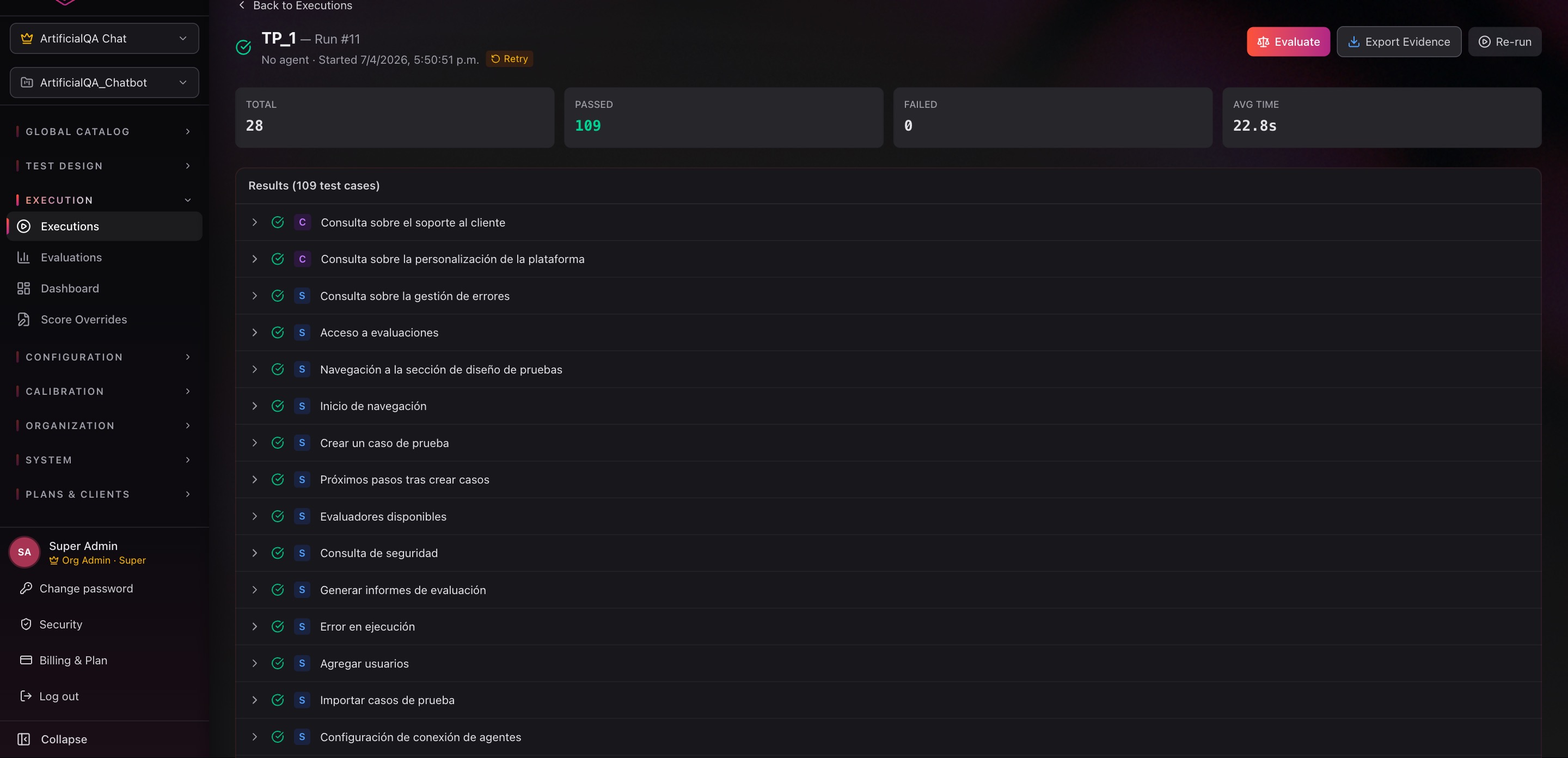

3. Correr el Test Plan

Desde la lista de Test Plans, haz clic en Run sobre el plan que quieres ejecutar y elige la Agent Connection contra la que se va a correr. La plataforma ejecuta todos los casos de todas las suites asignadas al plan, contra la conexión seleccionada.

Vista en tiempo real

Mientras corre verás:

- Progreso (X de N casos).

- Caso actual ejecutándose.

- Casos completados con su resultado preliminar (verde/rojo según los asserts determinísticos; los evaluadores LLM corren después).

- Tiempo transcurrido y estimado restante.

Estados del Run

- Pending — en cola, esperando para arrancar.

- Running — ejecutándose.

- Completed — terminó. Las respuestas quedaron capturadas. El run aparece en la pestaña Ready to Evaluate de la página de Evaluations, listo para enviar a evaluación (paso opcional).

- Failed — algo cortó la ejecución (conexión inalcanzable, error fatal, etc.).

- Cancelled — el usuario canceló la ejecución antes de terminar.

Casos conversacionales

Cuando un caso es multi-turno, ArtificialQA mantiene la sesión con el agente de IA a lo largo de todos los turnos del caso. La respuesta a cada turno se guarda y se evalúa en el contexto de la conversación.

Tokens consumidos durante la ejecución

Depende del protocolo de la conexión:

- HTTP/API: la llamada al agente de IA no consume tokens del pool de ArtificialQA. Es ilimitada (dentro de los cupos de ejecución de tu plan).

- Browser (Playwright): consume tokens, porque la plataforma usa un LLM (AI Locator) para detectar dinámicamente el chat dentro de la página cuando los selectores CSS no son suficientes. Es uno de los costos a la hora de elegir entre HTTP y Browser.

Otras fases que consumen tokens, sin importar el protocolo:

- La generación con IA antes de ejecutar (si los casos los generaste así).

- La fase de evaluación con LLM (que sucede en el siguiente paso).

- La generación de informes con IA (solo en plan Enterprise): el resumen ejecutivo y el análisis por evaluador se generan con un LLM.

Snapshots inmutables (y reproducibilidad no determinista)

Cada Run guarda un snapshot completo: input enviado, headers, response crudo, tiempos y logs. Aunque después modifiques el Test Case, la Connection o la Suite, el Run conserva exactamente lo que pasó esa vez. Esto es lo que permite auditar resultados meses después.

Pero ojo con la reproducibilidad: el snapshot es inmutable, pero si vuelves a ejecutar el mismo Test Plan, las respuestas del agente de IA pueden ser distintas — hay un LLM detrás del agente de IA y los LLMs no son deterministas. Lo que queda fijo es lo que pasó en cada corrida específica, no lo que va a pasar en futuras corridas.

Errores comunes y cómo resolverlos

- Timeout en respuestas. Sube el timeout en la conexión. Si el agente de IA tarda mucho legítimamente, ajusta la expectativa.

- Selector no encontrado (Browser). El DOM cambió. Actualiza los selectores en la conexión. La pantalla de Test Connection muestra dónde falló el flujo y los logs del Run quedan disponibles para inspección.

- 401 / 403 (HTTP). Credenciales vencidas. Renuévalas en la conexión.

Próximo paso

Ya tienes el Run con todas las respuestas. El próximo paso es activar los evaluadores sobre ese run.